Fake You! Wie KI-Deepfakes unsere Realität zersetzen

Täuschend echt – und zutiefst gefährlich: Deepfakes sind mehr als ein digitaler Scherz. Sie gefährden Vertrauen, zerstören Reputationen und verwandeln Realität in ein manipulierbares Produkt. Was passiert, wenn wir unseren eigenen Augen nicht mehr trauen können?

Die Gefahr von Deepfakes und die zunehmende Auflösung der Grenze zwischen Wahrheit und Täuschung.

Stellen Sie sich vor, jemand schickt Ihnen ein Video. Darin zu sehen: Sie selbst. Wie Sie fröhlich für ein Produkt werben, das Sie nie benutzt haben. Ihre Stimme. Ihr Gesicht. Ihre Mimik. Alles sieht echt aus. Nur: Sie haben dieses Video nie aufgenommen. Willkommen in der neuen Realität. Oder besser gesagt: in einer gefälschten.

Wir leben im Zeitalter der Bilder. Und bislang galt: Ein Video lügt nicht. Wer etwas mit eigenen Augen sieht, glaubt es. Doch diese Grundlage zerbröckelt. Deepfakes – also mithilfe künstlicher Intelligenz manipulierte Medieninhalte – machen es möglich, Menschen Dinge sagen und tun zu lassen, die sie nie gesagt oder getan haben. Die Technologie dahinter war früher Hightech. Heute ist sie eine App. Für alle. Realität ist manipulierbar geworden – und zwar nicht irgendwann, sondern jetzt.

Die Demokratisierung der Täuschung

Was früher nur mit großer Rechenpower und Know-how ging, kann heute jeder Teenager mit einem Smartphone erzeugen: ein Video, in dem zwei Menschen sich küssen, obwohl sie sich nie begegnet sind. Ein Clip, in dem Politiker:innen scheinbar Ungeheuerliches sagen. Oder eine Fake-Werbung, in der Influencer:innen scheinbar für ein Produkt werben. Alles per Knopfdruck. Apps wie Creati AI, Reface, HeyGen oder ElevenLabs machen’s möglich. Von Voice-Cloning bis Face-Swapping – alles per App oder KI-Bot. Die Folge: Realität wird zur Option. Wahrheit zur Verhandlungsmasse.

Vertrauen als Währung – und als Opfer

Besonders betroffen: Menschen, die auf Vertrauen angewiesen sind. Influencer:innen, Journalist:innen, Politiker:innen, Wissenschaftler:innen. Wer sich eine Community aufgebaut hat, verliert durch ein einziges gefälschtes Video seine Glaubwürdigkeit. Und mit ihr: Reichweite. Relevanz. Umsatz. Eine Forrester-Studie warnt vor tiefgreifenden Auswirkungen auf Markenwahrnehmung und Unternehmenserfolg. Vertrauen ist heute Währung – und Deepfakes können es binnen Sekunden entwerten. Deepfakes zerstören diesen „Vertrauensvorschuss“ mit einem einzigen Clip. Die ökonomischen Folgen: Umsatzverluste, Reputationsschäden, Haftungsfragen. Und gesellschaftlich? Da wird der gute alte Satz „Ich glaube nur, was ich sehe“ zum Witz.

Fake News reloaded

Deepfakes sind keine Tech-Spielerei. Sie sind das Update der Desinformation. Deepfakes sind nicht nur lustige TikTok-Spielereien – sie sind Waffe und Werkzeug. Fake News bekommen Gesichter, Stimmen, Gefühle. Und damit eine ganz neue Durchschlagskraft. Wer soll noch unterscheiden, was wahr ist – wenn selbst das Offensichtliche inszeniert sein kann? Politische Manipulation, Wirtschaftskriminalität, Rufmord – das wird damit in ganz neue Dimensionen katapultiert. Ideen? Reichlich: Fake-Reden von Politiker:innen. CEOs, die angeblich Insolvenzen ankündigen. Und da hab ich mein diabolisches Gehirn noch nicht mal angeschmissen. Wir wissen alle, zu welchen Greuel- und Schandtaten wir Menschen fähig sind. Da sind meine Ideen harmlos. Aber mit Absicht. Ich will auch gar nicht weiter denken - denn mir läuft es jetzt schon kalt den Rücken herunter.

Wir stehen vor einem Paradigmenwechsel. Die Frage ist nicht mehr nur: Ist das wahr? Sondern: Könnte es auch falsch sein? Die ständige Möglichkeit der Manipulation erzeugt Misstrauen. Und Misstrauen ist ein Gift für jede demokratische und anständige Gesellschaft.

Deepfakes wirken oft (noch) harmlos, beinahe witzig. K-Pop-Star Jeon Somi etwa sah sich im Juni mit Vorwürfen konfrontiert, ihr Musikvideo enthalte Deepfake-Szenen. Ein PR-Stunt? Vielleicht. Ein Vertrauensverlust? Ganz sicher. Aber in dem Fall ist es eben Kunst. Und Kunst darf doch eigentlich per se und sowieso alles. Und welche Musikvideos sind bitte schön echt? Sie waren es nie. Immer inszeniert.

In Australien wurden zwei Sportreporterinnen Ziel von KI-generierten Bikini-Videos – Fake-Pornos, die real wirken, aber allein der Demütigung dienen. In Indien kursierte ein manipuliertes Video von Premierminister Modi – mit angeblich brisanten Aussagen. Und in Deutschland? Hier geht es bislang meist um gefälschte Politikerstatements auf Telegram, getunte Promi-Stories, Influencer:innen, die Produkte anpreisen, die sie nie verkauft haben oder Aussagen treffen, die sie nie getätigt haben. Oder manipulierte Bewerbungsvideos. Noch.

Was all diese Fälle eint: Sie sind erst der Anfang. Und wirken auf den ersten Blick harmlos. Man lacht, man staunt, man scrollt weiter. Doch genau diese Harmlosigkeit macht sie so gefährlich. Denn sie vernebeln unsere Wahrnehmung. Und untergraben das, worauf wir als Gesellschaft angewiesen sind: Vertrauen.

Dabei, könnte man sagen, war doch sowieso schon immer alles Fake. Oder?

Schon in den 80ern und 90ern haben Photoshop und Bildmanipulation Realitäten verzerrt. Werbung hat uns seit jeher suggeriert, wie wir aussehen, leben, riechen sollen. Romane sind erfundene Welten, Social Media sowieso. Selbst im Journalismus ist das Vertrauen erschüttert – durch Skandale, Fakes, Narrative. Und mal ehrlich: Wie oft lügen wir selbst am Tag? Kleine Schummeleien, Ausreden, Filter – gehört das nicht längst zur Normalität?

Vielleicht ist die Wahrheit nicht verschwunden. Vielleicht war sie nie da.

Was ist Wahrheit überhaupt in einer Welt, in der wir unsere Identität täglich neu inszenieren – in Posts, in Gesprächen, in Mails? Wenn alles Erlebte sofort dokumentiert, bearbeitet und kommentiert wird – was ist dann noch echt? Aber genau hier liegt das Problem: Wenn alles Fiktion ist, gewinnt der, der am lautesten lügt. Wenn niemand mehr sagen kann, was stimmt – dann hat die Manipulation gewonnen.

Deepfakes führen uns also nicht nur technologisch, sondern philosophisch an den Abgrund: Was bleibt von der Realität, wenn sie sich in Clips, Codes und Algorithmen auflöst?

Deepfake-Pornos: Digitale Gewalt auf neuem Level

Besonders perfide: Deepfakes als Waffe gegen Frauen. Revenge Porn, Non-Consensual AI Porn – besonders betroffen: Frauen. In den letzten Jahren explodierte die Zahl an KI-generierten Pornovideos, in denen Gesichter realer Frauen – oft ohne deren Wissen – auf fremde Körper montiert werden. Der Effekt ist verheerend. Jobverlust. Traumatisierung. Rufmord. Und eine entsetzliche Ohnmacht: Wie beweist man, dass man nicht in einem Video ist, das aussieht wie man selbst?

Diese Form der digitalen Gewalt trifft vor allem Frauen. Und sie trifft sie unvorbereitet. Der Rechtsstaat? Hinkt hinterher. Die Plattformen? Oft träge oder desinteressiert. Der Schutz? Minimal. Die Scham? Maximal. Eine bittere Beweislastumkehr: Wer betroffen ist, muss sich rechtfertigen. Während die Täter in Deckung bleiben.

Plattformen: Zwischen Verantwortung und Profit

Es ist alles so wie immer: Profit vor Schutz. Plattformen wie Meta verdienen mit Deepfake-Werbung mit. Allein Creati AI schaltete mehr als 27.000 Anzeigen auf Facebook und Instagram. Und obwohl der Digital Services Act klare Regeln zur Entfernung illegaler Inhalte vorsieht, bleibt die Umsetzung mangelhaft. Anzeigen werden automatisiert freigegeben, Beschwerden dauern Tage. Wer denkt, KI wäre das Problem – irrt. Die eigentliche Frage lautet: Wer kontrolliert die, die KI kontrollieren?

Neue Aufgaben für eine neue Realität

Wir brauchen mehr als technische Lösungen. Wir brauchen Bewusstsein. Medienkompetenz. Digitale Mündigkeit. Schulen, Unternehmen, Medienhäuser, Gesetzgeber – alle sind gefragt. Es braucht:

klare Kennzeichnungspflichten für KI-generierte Inhalte

schnelle Melde- und Löschsysteme auf Plattformen

strafrechtliche Konsequenzen für Deepfake-Missbrauch

Bildungsoffensiven in Sachen Medienkritik und Aufklärung: Digitale Aufklärung als Pflichtfach!

Unternehmen brauchen neue Strategien für Marken- und Reputationsschutz.

Und wir als Einzelne? Medienkompetenz ist Selbstschutz.

Und vor allem: einen gesellschaftlichen Konsens, dass Wahrheit schützenswert ist. Dass Aufklärung wichtiger ist als Klicks. Und dass Empathie stärker ist als Scham.

Was bleibt, wenn nichts mehr echt ist?

Deepfakes zeigen uns eine unbequeme Wahrheit: Unsere Realität ist verletzlich. Und unser Vertrauen ein fragiles Gut. Doch vielleicht liegt genau hier die Chance. In einer Welt voller Möglichkeiten zur Täuschung wird das Echte wieder kostbar. Echtheit. Aufrichtigkeit. Transparenz. Vielleicht ist genau das die Zukunft: eine neue Kultur des Zweifelns, aber auch des Bewusstseins.

Denn am Ende können wir nur das verteidigen, was wir als wertvoll erkennen. Und Wahrheit war nie so wertvoll wie heute. Vertrauen wird zur wichtigsten Ressource der Zukunft. Die große Aufgabe: Wahrheit wieder sichtbar machen – und verteidigen.

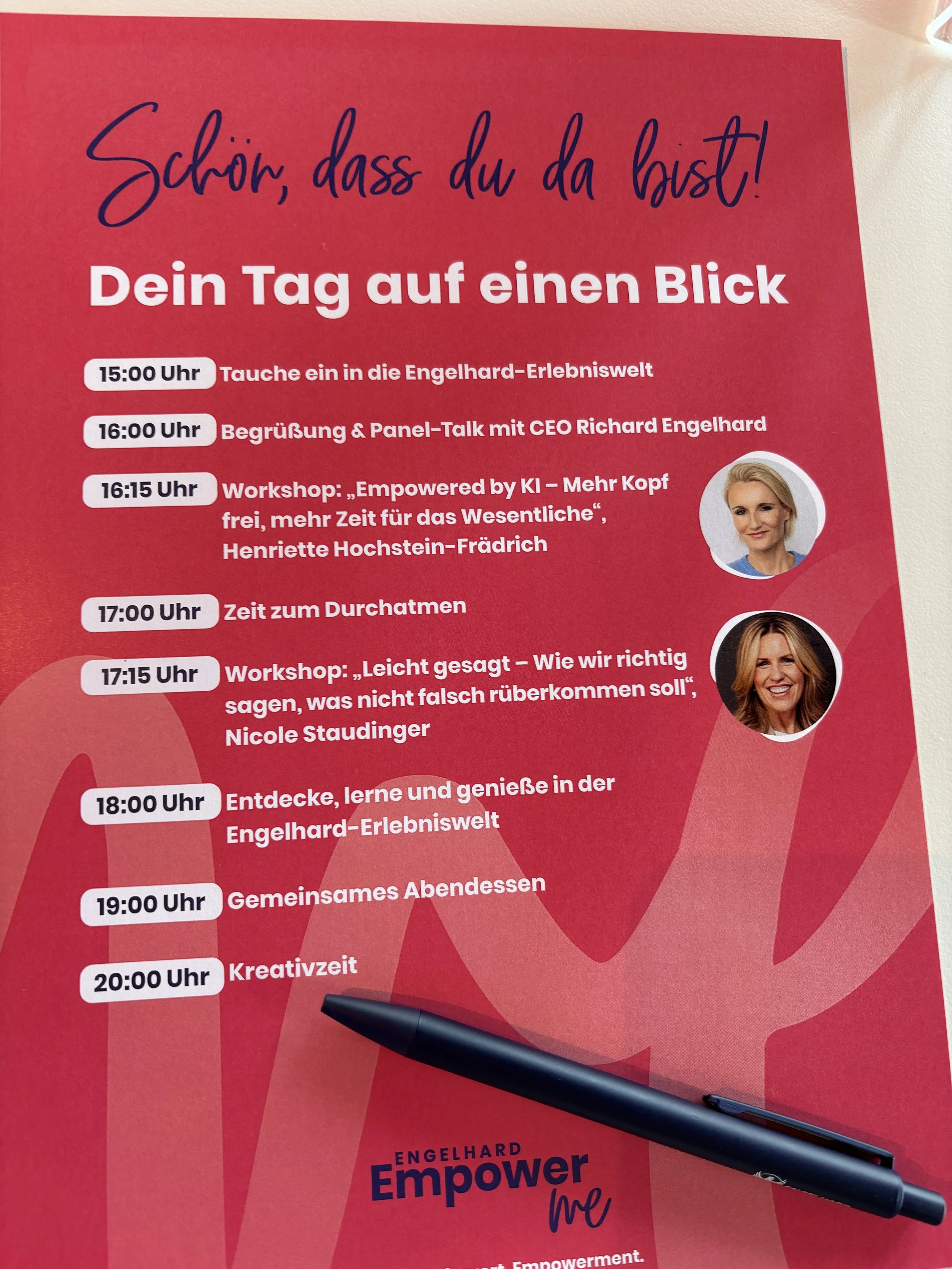

Vortrag oder Workshop KI und Künstliche Intelligenz

für Unternehmen & Veranstaltungen gesucht?

Wenn Sie genau an dieser Schnittstelle stehen …

… zwischen KI, Veränderung, Innovation und der Frage, was davon wirklich relevant ist: Dann ist genau das der Raum, in dem Henriette Hochstein-Frädrichs Vorträge ansetzen. Nicht als abstrakte Zukunftsvision. Sondern als sehr konkrete, unternehmerische Perspektive:

Was KI heute tatsächlich möglich macht. Wo sie echten Impact hat – und wo nicht. Und wie wir sie sinnvoll in unsere Arbeit, unsere Entscheidungen, unsere Geschäftsmodelle - und ja, auch unseren privaten Alltag - integrieren können.

Hier mehr über Henriettes Vorträge rund um Künstliche Intelligenz erfahren

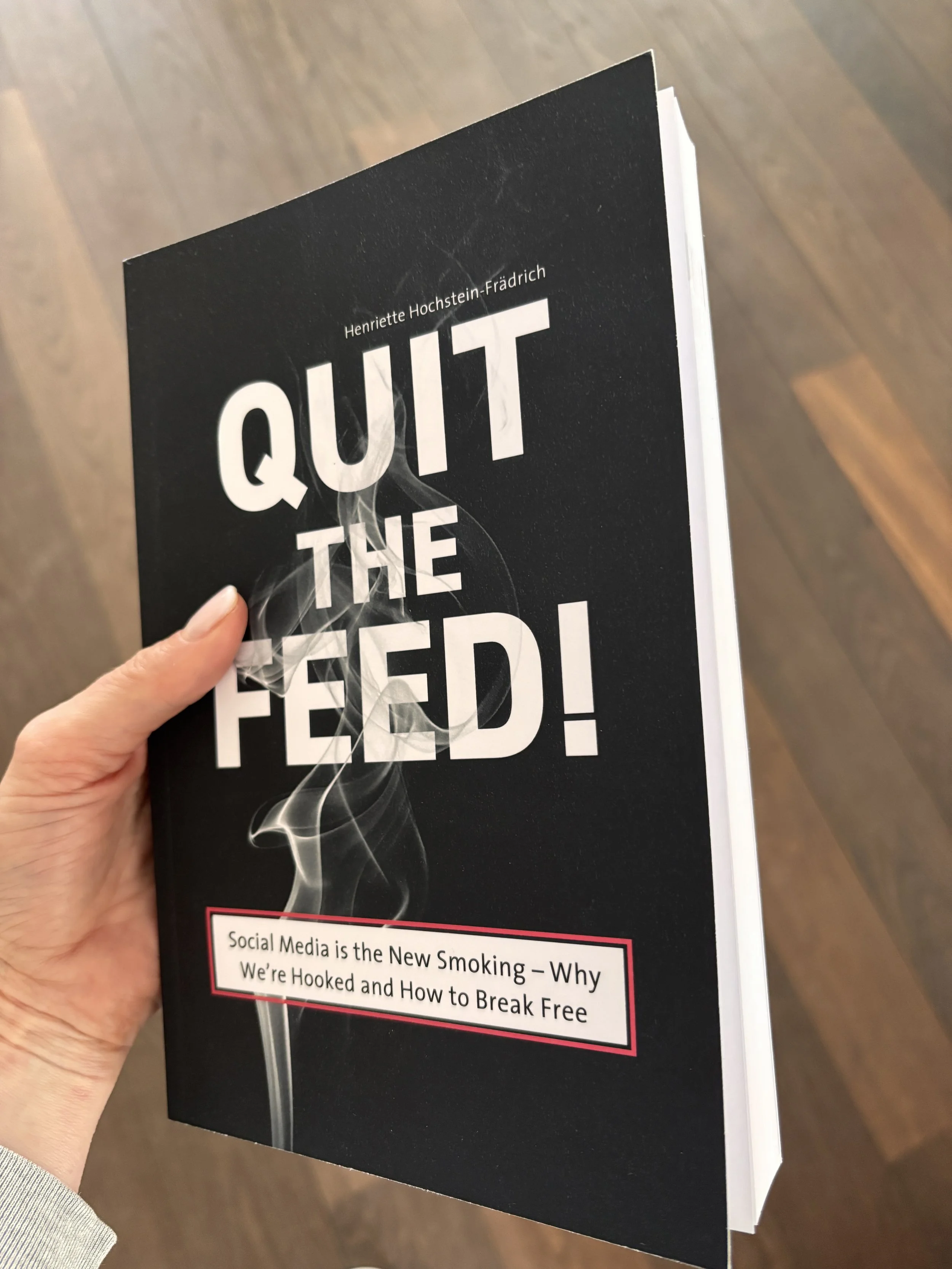

Über die Autorin: Henriette Hochstein-Frädrich

Unternehmerin. Plattformgründerin. Autorin. Keynote-Speakerin. Und jemand, der KI nicht erklärt, sondern nutzt. Sie glaubt nicht an Hype, sondern an Verstehen, Selbstwirksamkeit und bewusste Entscheidungen. Während viele noch darüber reden, welche Tools es gibt, arbeitet sie längst damit – im Aufbau von Plattformen, in der Entwicklung von Geschäftsmodellen und im täglichen Arbeiten. Ihr Fokus liegt nicht auf Technologie, sondern auf dem, was sie verändert. Denn die eigentliche Frage ist nicht, was KI kann. Sondern was sie mit uns macht. Und was wir mit ihr machen. Genau darum geht es in ihren Vorträgen.

Henriette Hochstein-Frädrich ist Keynote-Speakerin, Unternehmerin, Autorin und Multi-Plattformgründerin – und eine der klarsten Stimmen, wenn es um Veränderung, Motivation, Führung und den bewussten Umgang mit neuen Technologien geht.

Seit über 15 Jahren arbeitet sie mit Unternehmen, Organisationen und Menschen, die nicht nur funktionieren wollen, sondern verstehen, gestalten und Verantwortung übernehmen möchten. In ihren Vorträgen und Workshops verbindet sie Psychologie, Neurowissenschaft, gesellschaftliche Entwicklungen und eigene unternehmerische Erfahrung zu Impulsen, die wirken – ohne zu belehren und ohne zu beschönigen.

Henriette Hochstein-Frädrich steht für Substanz statt Buzzwords, für Klarheit statt Hype und für echte Anwendung statt theoretischer Begeisterung. Sie arbeitet selbst seit Jahren mit Künstlicher Intelligenz – im Aufbau von Plattformen, in der Entwicklung von Geschäftsmodellen und im täglichen Denken und Entscheiden. Für sie ist KI kein Trend, sondern ein Werkzeug – und vor allem ein Spiegel dafür, wie wir arbeiten, führen und miteinander umgehen. Ihr Ansatz ist dabei klar: Nicht die Technologie steht im Mittelpunkt. Sondern immer der Mensch, der sie nutzt.

Themen: Deepfakes, KI, Vertrauen, DigitaleEthik, Medienkompetenz, Künstliche Intelligenz, Fake News, Digitalisierung, Deepfake, KI, Identitätsdiebstahl, digitale Täuschung, Vertrauen, künstliche Intelligenz, Fake News, Deepfake Illustration, glitch art, Realität manipuliert, Medienkompetenz